Vercel AI SDK入門|Next.jsで高度なAIチャットUIを構築する実践ガイド

コセケン

テクラル合同会社

AIチャットUIの開発において、ストリーミング応答や複雑な状態管理は大きな課題となりがちです。

しかし、Vercel AI SDKを活用すれば、これらの課題を効率的に解決し、Next.jsで高度なAIチャットアプリケーションを迅速に構築できます。

本記事では、Vercel AI SDKの主要機能からUI構築の効率化、デプロイ最適化、運用時の監視まで、実践的なノウハウを解説します。

Vercel AI SDKの基本と導入メリット

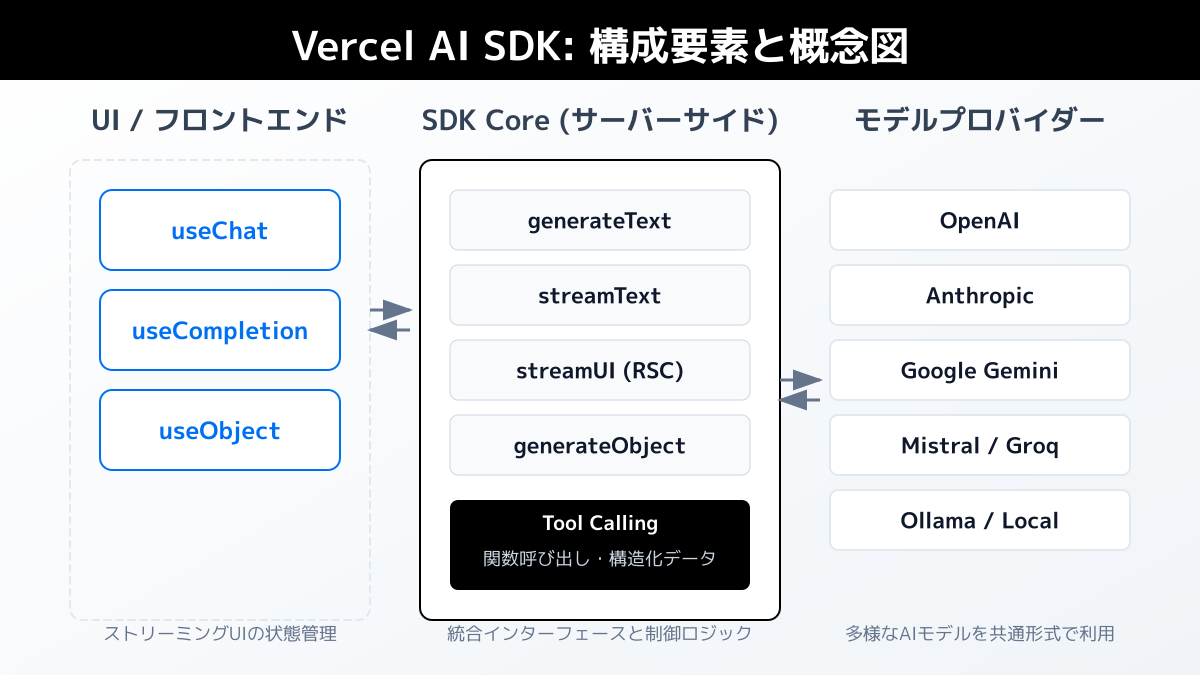

Vercel AI SDKの基本として、まずはその主要なコンポーネントと役割を理解することが重要です。Next.jsなどのモダンなフレームワークと組み合わせることで、LLM(大規模言語モデル)を活用したチャットUIを迅速に構築できます。

導入を検討する際のポイントは、 ストリーミング処理の容易さ と、複数モデル(OpenAIやAnthropicなど)への切り替えコストの低さです。自社のプロダクトにおいて、リアルタイムな応答性が求められる場合、このSDKは強力な選択肢となります。

特に、MVP開発とは?新規事業の失敗リスクを下げるアジャイルな進め方と検証ポイントの段階において、素早くプロトタイプを構築し、ユーザーの反応を確かめる用途に最適です。

一方で、サーバーレス環境で実行する場合、関数のタイムアウト制限やAPIの従量課金コストに気を配る必要があります。プロンプトのバージョン管理やエラーハンドリングの実装を初期段階で設計しておかないと、後々の 技術的負債 につながります。

Vercel AI SDK UIによるフロントエンド構築

Vercel AI SDKを活用する上で、フロントエンドのUI構築をいかに効率化できるかが重要になります。

AIチャットUI構築を効率化する機能

Next.jsでAIアプリケーションを開発する際、状態管理やAPI通信の処理が複雑になりがちです。しかし、Vercel AI SDK UIのパッケージを利用すれば、 実装工数を大幅に削減 できます。

提供されている useChat フックを活用することで、入力状態の管理からメッセージ履歴の保持、AIからのストリーミング応答までをシンプルに実装可能です。

以下は、useChat を用いたNext.js(App Router)でのチャットUIの基本的な実装サンプルです。

'use client';

import { useChat } from 'ai/react';

export default function Chat() {

const { messages, input, handleInputChange, handleSubmit } = useChat();

return (

<div className="flex flex-col w-full max-w-md py-24 mx-auto stretch">

{/* メッセージ履歴の表示 */}

{messages.map(m => (

<div key={m.id} className="whitespace-pre-wrap mb-4">

<strong>{m.role === 'user' ? 'ユーザー: ' : 'AI: '}</strong>

{m.content}

</div>

))}

{/* 入力フォーム */}

<form onSubmit={handleSubmit}>

<input

className="fixed bottom-0 w-full max-w-md p-2 mb-8 border border-gray-300 rounded shadow-xl"

value={input}

placeholder="メッセージを入力..."

onChange={handleInputChange}

/>

</form>

</div>

);

}

このように、わずかなコードで状態管理とストリーミング対応のUIを構築できるのが、Vercel AI SDKの大きな魅力です。

現場での運用ポイント

プロダクトにAIを組み込む際、ユーザー体験を損なわないレスポンス速度が求められます。Vercel AI SDKは ストリーミング応答を標準サポート しており、LLM特有の生成待ち時間を体感的に短縮できるのが大きな強みです。

APIコールの頻度が増加するため、トークン消費量の監視やレートリミットの設定が不可欠です。また、Next.jsのEdge Runtime環境を利用する場合は、タイムアウトやメモリ上限を考慮したエラーハンドリングの設計が必要です。

プロダクト成長を見据えた設計

高度なAIチャットUIの実装は、ユーザーエンゲージメントを高める重要な施策です。MVP開発の初期段階から拡張性に優れた技術を選定することが、後の事業成長を左右します。

AIを活用したプロダクトを立ち上げる際は、新規事業の立ち上げで失敗しない7つのプロセス|実践フレームワークと成功手法も参考にしながら、ビジネス要件に合わせた最適なアーキテクチャを構築してください。

Vercel AI Chatのストリーミング処理

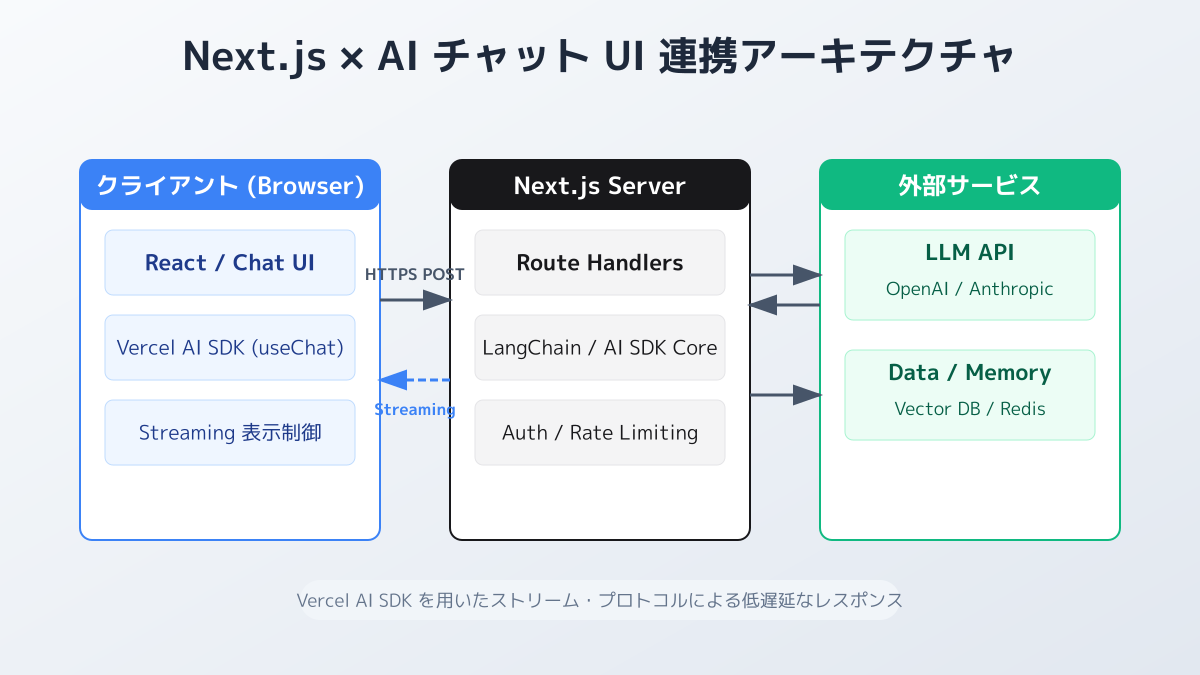

Vercel AI SDKを活用する上で押さえておくべきポイントは、ストリーミングレスポンスとチャットUIのシームレスな統合です。LLMを用いたアプリケーション開発において、ユーザー体験を大きく左右するのが応答速度です。

ストリーミング処理とUI構築

従来のAPIリクエストでは、LLMがすべてのテキストを生成し終えるまでユーザーは待機する必要がありました。しかし、Vercel AI SDKを導入することで、生成中のテキストをリアルタイムで画面に描画する ストリーミング処理 を簡単に実装できます。

特にVercel AI Chatに関連するフック(useChat など)を利用すれば、メッセージの履歴管理やローディング状態の制御といった状態管理を数行のコードで実現可能です。これにより、開発者は複雑な状態管理から解放され、UIの作り込みに専念できます。

採用における判断基準

プロジェクトで本機能を活用するかどうかの基準は、「リアルタイムな対話体験がプロダクトの価値に直結するか」という点にあります。

たとえば、カスタマーサポートの自動応答や社内ドキュメントの検索アシスタントなど、ユーザーが即座のフィードバックを求める場面では非常に有効です。一方で、バックグラウンドでの非同期なバッチ処理であれば、あえてストリーミング処理を組み込む必要性は低くなります。

現場で運用する際の注意点

実際に現場で運用する際には、いくつかの技術的な注意点があります。第一に、 エラーハンドリングの設計 です。ストリーミング中にネットワーク切断やAPIのレートリミット超過が発生した場合、ユーザーにどのようなフィードバックを返すかを事前に定義しておく必要があります。

第二に、 トークン消費の監視 です。チャットUIではユーザーとAIのやり取りが連続するため、過去のメッセージ履歴を送信し続けると、APIの利用料金が想定外に膨らむリスクがあります。送信する履歴の件数を直近数件に制限するなどの工夫が求められます。

チャットUIの実装とパフォーマンス最適化

Vercel AI SDKを活用したシステム開発において、ユーザー体験を直接的に左右する重要な要素がフロントエンドの構築です。

高度な表現の実現

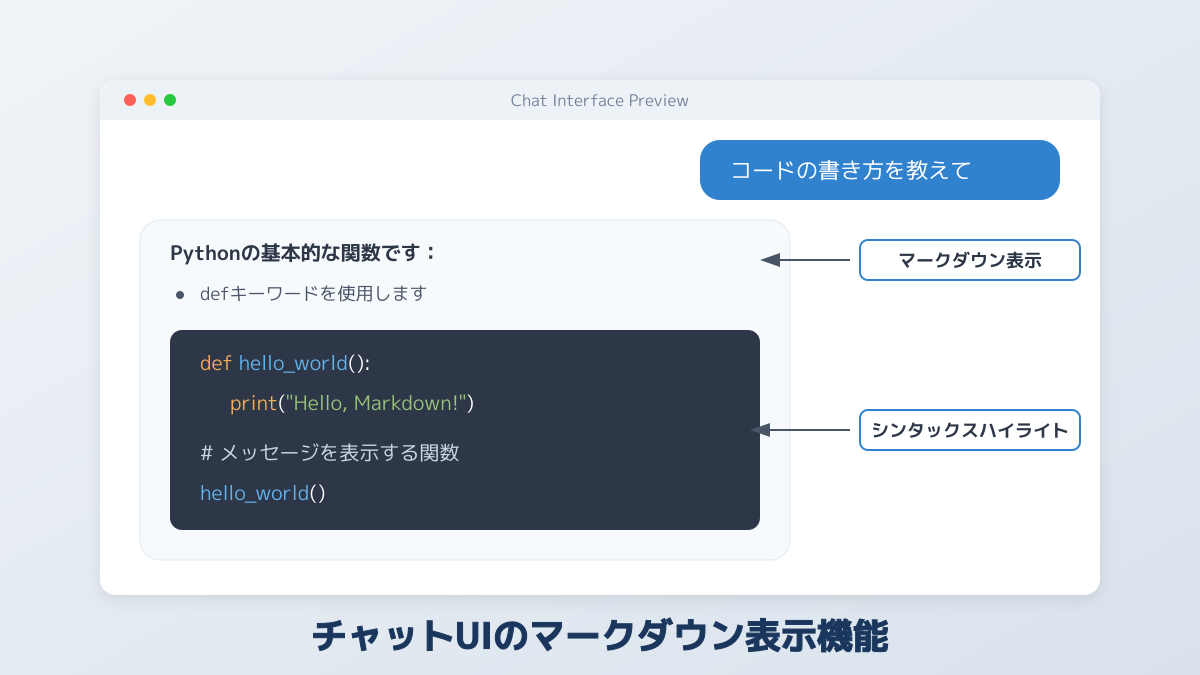

LLMを組み込んだアプリケーションでは、生成されたテキストをいかに素早く、かつ読みやすく表示するかが問われます。Vercel AI SDK UIパッケージを利用すると、Next.jsのReactコンポーネントとして、ストリーミング対応のチャットインターフェースを極めて短いコードで実装できます。

特に、マークダウンの自動パースやコードブロックのシンタックスハイライトなど、リッチなテキスト表現を容易に実現できる点が大きな強みです。自社で一から状態管理やUIレンダリングのロジックを設計する工数を省き、コアとなるビジネスロジックの開発にリソースを集中させることが可能になります。

現場でのカスタマイズとパフォーマンス管理

実際のプロダクト開発において、標準のUIコンポーネントをどこまでカスタマイズするかが重要となります。新規事業の立ち上げや MVP(Minimum Viable Product)検証 のフェーズでは、まずは標準機能を活用して最速で市場に投入し、ユーザーのフィードバックを得ることを優先すべきです。

その後、事業の成長に合わせて自社ブランドに沿った独自のデザインへ拡張していくアプローチが効果的です。

一方で、クライアント側のパフォーマンス管理にも気を配る必要があります。LLMからの応答はチャンクごとにリアルタイムでストリーミングされるため、複雑なマークダウンが連続して描画されると、ブラウザの処理負荷が高まる傾向があります。

これを防ぐためには、不要な再レンダリングを抑えるためのコンポーネント設計や、Reactのメモ化といった パフォーマンス最適化 を初期段階から組み込んでおくことが重要です。

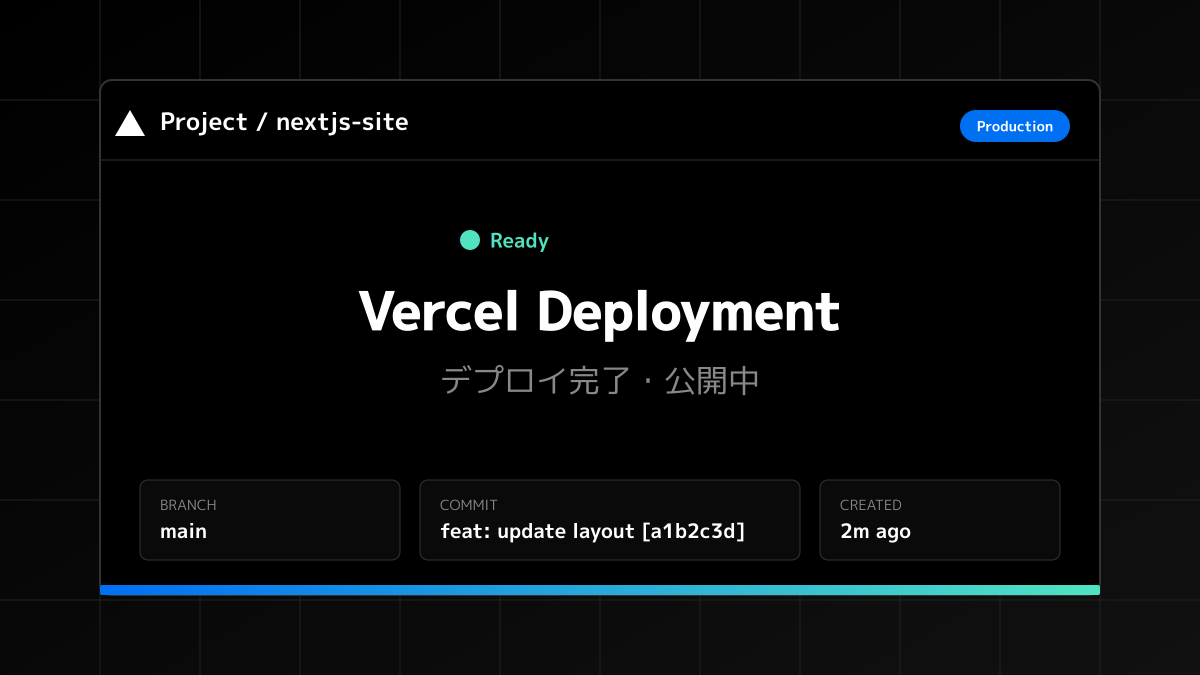

Edge Functionsを活用したデプロイ最適化

高度なAIチャットUIを本番環境で安定稼働させるためには、デプロイ環境の最適化が欠かせません。ここでは、エッジランタイムの活用という観点から解説します。

Vercel AI SDKは、VercelのEdge Functions(エッジ関数)と非常に相性が良く設計されています。AIモデルからのストリーミング応答をユーザーに最も近いサーバーから返すことで、 TTFB(最初のバイトが到達するまでの時間)を大幅に短縮 できるのが大きな強みです。

これにより、ユーザーを待たせない快適なチャット体験を実現します。

一方で、プロジェクトの要件に応じて適切なランタイムを選択することが重要です。Edgeランタイムは高速ですが、一部のNode.js標準APIや重い外部ライブラリが動作しないという制約があります。

そのため、既存のデータベース接続や複雑なバックエンド処理を伴う場合は、従来のNode.jsランタイムを選択する方が安全なケースもあります。

また、現場で運用する際は、 タイムアウト制限の管理 が求められます。大規模言語モデル(LLM)の推論には数十秒かかることも珍しくありません。

Vercelの無料プランや標準設定では、関数の実行時間が短く制限されている場合があるため、設定ファイルで実行上限時間を適切に見直す必要があります。

運用時の監視とエラーハンドリング

Vercel AI SDKを本番環境で活用する際の最後のポイントは、運用時の監視とエラーハンドリングの徹底です。開発環境ではスムーズに動作しても、実際の運用フェーズでは予期せぬ課題が発生しやすくなります。

AI機能を組み込んだアプリケーションでは、LLMのAPIレートリミットやプロバイダー側の応答遅延がユーザー体験に直結します。そのため、ストリーミング応答が途切れた際のフォールバック処理や、タイムアウト時の適切なUI設計をあらかじめ組み込んでおくことが不可欠です。

現場で運用する際は、どの程度のエラーまでをユーザーに通知し、どこからをシステム側で自動再試行するかの切り分けが求められます。

とくに、トークン消費量やAPIコールの成功率をモニタリングする仕組みを導入し、ランニングコストとパフォーマンスのバランスを常に可視化しておくこと が重要です。

さらに、プロンプトインジェクションなどのセキュリティリスクへの対策も忘れてはいけません。ユーザーからの入力値のサニタイズや、LLMが生成した出力のフィルタリングをサーバーサイドで適切に実装する必要があります。

まとめ

Vercel AI SDKは、Next.jsを用いたAIチャットUI開発を加速させる強力なツールです。本記事では、その導入から運用までを成功させるための重要ポイントを解説しました。

- 開発効率の向上:

useChatフックやVercel AI SDK UIを活用し、実装工数を大幅に削減。 - ユーザー体験の最適化: ストリーミング処理とUI統合により、リアルタイム性の高い応答を実現。

- デプロイと運用: Edge Functionsでのパフォーマンス向上、監視・エラーハンドリングで安定稼働を確保。

- スケーラビリティとセキュリティ: 初期設計段階からこれらを考慮し、将来的な成長と安全性を担保。

これらの知見を活かすことで、開発者は複雑なAIアプリケーションをより迅速に、そして安定的に市場へ投入できます。AIプロダクトの成功には、技術選定だけでなく、運用を見据えた包括的なアプローチが不可欠です。

この記事を書いた人

コセケン

テクラル合同会社

スタートアップでのCTO経験を経て、現在はテクラル合同会社にてシステム開発全般を牽引しています。アプリおよびWebの開発から、バックエンド、インフラ構築に至るまで幅広い技術領域に対応可能です。スピード感を持った品質の高いシステム開発を得意としており、新規プロダクトの立ち上げを一気通貫で支援します。本ブログでは実践的な開発ノウハウを発信していきます。