ChatGPTで思い通りの画像を生成するプロンプトのコツと商用利用・著作権の注意点

タジケン

テクラル合同会社

ChatGPTに搭載された画像生成AI(DALL-E 3)は、ビジネスにおけるクリエイティブ制作の可能性を大きく広げます。しかし、多くの企業担当者や新規事業責任者は、生成画像の商用利用の可否や著作権、倫理的な問題、そして効果的なプロンプトの書き方について不安を抱えているのではないでしょうか。本記事では、OpenAIの最新規約に基づいた商用利用の現状と、企業が直面しうる法的・倫理的リスクへの具体的な対策を解説します。この記事を読むことで、DALL-E 3を安全かつ効果的にビジネスで活用するための知識と、実践的なプロンプト作成のヒントが得られます。

生成AI全般の基本知識やビジネス導入向けのツール比較については、生成AIとは?仕組み・種類とビジネス向けおすすめツールを徹底解説 もあわせてご覧ください。

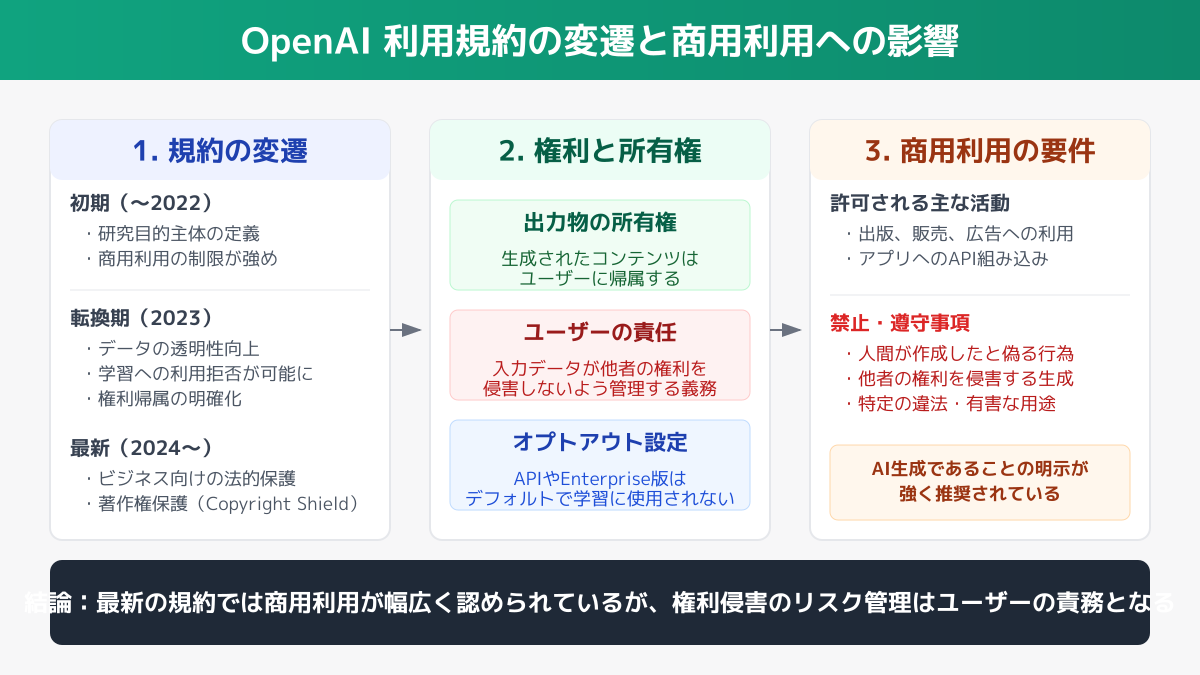

OpenAIの利用規約と著作権ポリシーの現状

OpenAIの利用規約に基づく画像生成の商用利用の現状

ChatGPTに搭載されている画像生成モデル(DALL-E 3)を活用する際、多くの企業担当者や新規事業の責任者が最初に直面する懸念が、利用規約の解釈と法的リスクです。結論から言えば、現在のOpenAIの利用規約においては、生成した画像の商業利用が明確に許可されています。

ユーザーは、ChatGPTを通じて生成された画像を再販したり、商品化したりする権利を含む所有権を持ちます。つまり、自社のWebサイトのアイキャッチ画像、SNSの広告クリエイティブ、さらには販売用のグッズデザインとして、ChatGPTで生成した画像を商用利用することは、OpenAIの規約上は全く問題ありません (出典: Does OpenAI ever say definitively that Yes, Commercial Use of images is allowed (for paid users) - Reddit)。

過去のAIモデルや初期のサービスでは、商用利用に対する制限が設けられていた時期もありました。しかし現在では、有料プランのユーザーに対して幅広いビジネス活用が認められています。これにより、企業は外部のストックフォトサービスやイラストレーターへの発注コストを削減し、スピーディーにコンテンツを量産する体制を構築することが可能になりました。

生成画像の重複リスクとプロンプト設計の重要性

利用規約上で商用利用が許可されている一方で、機械学習モデルの仕組みに起因する特有の注意点も存在します。OpenAIの規約においても、出力結果がユーザー間で完全に固有なものになるとは限らない旨が明記されています。

たとえば、複数のユーザーが似たような画像生成プロンプトをChatGPTに入力した場合、システムが同一、または非常に類似した画像を生成する可能性があります。これは、自社が多額の広告費をかけて展開しているキャンペーンのメインビジュアルと全く同じ画像が、競合他社の広告で使われてしまうリスクがあることを意味します。

この重複リスクを最小限に抑え、自社のブランドイメージを守るためには、汎用的な短い指示ではなく、自社独自の文脈や詳細な条件を盛り込んだ高度なプロンプト設計が求められます。ブランドカラーの具体的な指定や、構図の細かな調整をプロンプトに組み込むことで、他者と被りにくい出力を引き出すことが可能です。プロンプトの基本やテンプレートについては、【そのまま使える】生成AIプロンプトのテンプレートと書き方のコツ が参考になります。

また、生成された画像をそのまま使用するのではなく、出力後に自社のデザイナーが加筆・修正を行い、独自の要素を付加するプロセスを挟むことが強く推奨されます。

日本の著作権法におけるAI生成物の保護要件

利用規約上は商用利用が可能であっても、法的な権利保護の観点では別の大きな課題が発生します。日本の著作権法では、著作物として認められるためには「思想又は感情を創作的に表現したもの」であることが求められます。

現在の法解釈では、AIが自律的に生成したコンテンツは、原則として「人間の創作的寄与」が介在していなければ著作物として保護されません。したがって、DALL-E 3に対してプロンプトを入力して生成した画像自体には、著作権が発生しない可能性が高いという見解が示されています (出典: Japanese Law Issues Surrounding Generative AI | Clifford Chance)。

これはビジネスにおいて非常に重要な意味を持ちます。自社が生成し使用している画像を、第三者が無断でコピーして競合サービスで使用した場合でも、その画像自体に著作権がないため、著作権侵害を理由とした差し止めや損害賠償の請求が極めて困難になります。

単に詳細なプロンプトを考えたというだけでは、現行法上は人間の創作性が認められにくい傾向にあります。画像に著作権を発生させるためには、人間による大幅な加筆修正や、複数の画像を組み合わせた独創的なコラージュなど、明確な創作的意図を持った加工プロセスが不可欠です。

新規事業やプロダクト開発への安全な組み込み方

生成された画像が著作権法による保護を受けにくいという前提に立つと、企業におけるAI画像生成の最適な活用領域は、「独占的な権利を必ずしも必要としない部分」となります。社内向けのプレゼンテーション資料の挿絵、Webサイトの背景テクスチャ、デザインの初期段階におけるモックアップ作成などが代表的です。

特に、リソースが限られている新規事業の立ち上げフェーズにおいては、スピードとコストの最適化が事業の成否を分けます。AIを活用して素早くプロトタイプを作成し、ユーザーの反応を確かめるアプローチは非常に有効です。このような、最小限のコストで仮説検証を繰り返すプロセスについては、MVP開発とは?新規事業の失敗リスクを下げるアジャイルな進め方と検証ポイント を参考にすることで、より実践的な事業開発のノウハウを得ることができます。

企業としてAI画像生成を業務フローに組み込む際は、OpenAIの利用規約の変更を定期的にモニタリングする必要があります。生成物をそのまま外部へ公開する場合のリスクを正しく評価し、法的リスクをコントロールしながら最新技術の恩恵を最大限に引き出す社内ガイドラインの策定が求められます。

企業がDALL-E 3の画像を商用利用する際の社内ガイドライン

企業が業務効率化やマーケティングコンテンツの制作においてAIを活用する動きが加速しています。とくにChatGPTに搭載されたDALL-E 3などの画像生成AIは、テキストの指示だけで高品質なビジュアルを作成できるため、非常に強力なツールです。しかし、法人として安全に画像生成機能を商用利用するためには、著作権法に基づく法的リスクを正確に理解し、従業員向けの明確な社内ガイドラインを策定することが不可欠です。

日本の著作権法におけるAI生成物の扱い

社内ガイドラインを策定する上でまず理解すべきは、AIが生成した画像そのものの法的地位です。日本の著作権法では、著作物は「思想又は感情を創作的に表現したもの」と定義されています。そのため、AIが自律的に生成したコンテンツには原則として「人間の創作性」が欠如しているとみなされ、著作物として保護されません。

実際に、生成AIのみを用いて作成された作品は著作権の対象外となる可能性が高いと指摘されています。ただし、人間が生成物に何らかの加工を施したり、創作的な寄与を行ったりした場合には、その作品に著作権が認められる余地があります (出典: Japanese Law Issues Surrounding Generative AI | Clifford Chance)。したがって、企業がDALL-E 3で生成した画像をそのまま自社の独占的なアセットとして保護することは難しく、競合他社に類似の画像を生成・使用されるリスクがあることを前提にビジネスを設計する必要があります。

「学習段階」と「利用段階」で異なる法的リスク

次に注意すべきは、AIの学習プロセスと、生成された画像の利用プロセスにおける法的責任の違いです。日本の著作権法は、情報解析を目的としたAIの機械学習における既存データの利用に対しては比較的寛容な規定を設けています。

しかし、AI生成物の「利用段階」における著作権侵害のリスクは、AI開発企業ではなく、画像を出力して利用するユーザー側が直接負うことになります。AIの学習データが合法的に収集されたものであっても、ユーザーが生成したコンテンツが既存の著作物に類似している場合、重大な民事責任や刑事責任に直面する可能性があります (出典: Generative AI and Japanese Copyright Law: A Legal Risk Guide for Businesses)。つまり、「AIが作ったから安全」という認識は誤りであり、最終的な出力物が他者の権利を侵害していないかを確認する責任は企業側にあります。

より詳細な企業向けリスク対策のガイドラインについては、生成AIの著作権侵害・法的リスクを回避するには?企業向け対策とガイドライン完全版 で詳しく解説しています。

安全な運用のための社内ガイドライン策定手順

これらの法的背景を踏まえ、企業がDALL-E 3を業務利用する際には、以下の項目を社内ガイドラインに盛り込むことを推奨します。

1. プロンプト入力時の禁止事項の明文化

意図しない著作権侵害を防ぐための第一歩は、入力段階での制限です。従業員が入力するプロンプトに、実在のアーティスト名、特定のブランド名、既存のキャラクター名、または著作権で保護された作品名を含めることを社内規程で明確に禁止します。「〇〇(有名画家)のスタイルで」といった指示は、既存作品に極めて類似した画像を生成するリスクを高めるため、抽象的な表現や一般的な画風(例:「水彩画風」「サイバーパンク調」など)を指定するようルール化します。

2. 生成画像の類似性チェックプロセスの導入

出力された画像を外部へ公開する前に、既存の著作物と類似していないかを確認するフローを設けます。とくに広告クリエイティブや製品パッケージなど、商用利用の重要度が高い場面では、画像検索ツールなどを活用し、類似する既存作品が存在しないかをスクリーニングする工程を必須とします。法務担当者や責任者の承認フローを組み込むことで、組織的なリスク管理が可能になります。

3. 生成履歴とプロンプトの記録・保管

後日、第三者から著作権侵害の指摘を受けた場合に備え、「どのような指示を与えて生成したか」という記録を残すことが重要です。使用したプロンプト、生成日時、担当者名、生成された元画像のデータをセットで社内データベースに保管します。これにより、特定の既存作品を意図的に模倣しようとしたわけではない(依拠性がない)ことを客観的に説明する材料となります。

4. AI生成物であることの明示基準

用途に応じて、その画像がAIによって生成されたものであることを明示するかどうかの基準を定めます。とくに報道、医療、金融などの高い信頼性が求められる領域や、顧客の購買決定に直結するコンテンツにおいては、透明性を確保するために「画像はAIにより生成されたイメージです」といった注記を入れることが、企業のブランド保護につながります。

ガバナンスと事業成長の両立

AIツールの導入は、業務効率化だけでなく、新規事業の立ち上げやプロダクト開発のスピードを劇的に向上させます。初期のアイデア検証やMVP(Minimum Viable Product)の開発フェーズにおいて、デザイナーのリソースを待つことなく高品質なモックアップ画像を用意できる点は大きなメリットです。

しかし、スピードを重視するあまり権利侵害のリスクを見落とせば、事業そのものが立ち行かなくなる恐れがあります。適切な社内ルールを敷くことは、AIの活用を制限するためではなく、従業員が安心してツールを使いこなし、事業成長に貢献できる環境を整えるための前向きな投資です。新規事業におけるリスク管理やプロセス設計についてさらに深く知りたい方は、新規事業の立ち上げで失敗しない7つのプロセス|実践フレームワークと成功手法 も合わせてご参照ください。

企業・事業者は、最新の法解釈やプラットフォームの規約変更を継続的にモニタリングし、社内ガイドラインを定期的にアップデートしていく姿勢が求められます。

DALL-E 3の画像生成における倫理的・社会的な問題(バイアスやフェイク画像)

企業が新規事業やマーケティング活動においてAIを活用する際、技術的な利便性だけでなく、倫理的・社会的な問題や法的なリスクを正確に把握することが不可欠です。特に画像生成AIは、視覚的なインパクトが強いため、意図せぬトラブルが企業のブランドイメージを大きく損なう可能性があります。本セクションでは、DALL-E 3を利用する上で知っておくべきバイアスやフェイク画像のリスク、そして著作権に関する基本事項を整理します。

画像生成AIが抱えるバイアスとフェイク画像のリスク

大規模言語モデルや画像生成AIは、インターネット上の膨大なデータを学習して構築されています。そのため、学習データに元々含まれている社会的な偏見やステレオタイプ(人種、性別、職業に関するバイアスなど)を、生成される画像にそのまま反映してしまうリスクが常に存在します。例えば、特定の職業を指定した際に特定の性別や人種ばかりが出力される、あるいは地域文化に対して偏った描写が行われるといった事象です。

また、実在の人物や出来事と見紛うような精巧なフェイク画像の生成も、重大な社会問題となっています。誤情報(ディープフェイク)が拡散されることで、個人の名誉毀損や政治的な混乱を引き起こす危険性があります。企業が公式なオウンドメディアや広告クリエイティブとして画像を公開する際、こうしたバイアスが含まれていたり、事実と異なる誤解を招く表現になっていたりしないか、人間の目による厳重なチェック体制を構築することが強く求められます。

DALL-E 3のコンテンツポリシーと保護機能

こうした倫理的・社会的な問題に対処するため、開発元であるOpenAIはDALL-E 3に対して厳格なセーフティ機能とコンテンツポリシーを組み込んでいます。これにより、ユーザーが意図せず有害なコンテンツを生成してしまうリスクをシステム側で低減しています。

具体的には、DALL-E 3は生存するアーティストのスタイル(画風)での画像生成要求をシステム側で自動的に拒否するように設計されています。また、クリエイターが自身の画像を将来の画像生成モデルの学習データから除外(オプトアウト)できる機能も提供されています (出典: DALL·E 3 | OpenAI)。これにより、クリエイターの権利保護とAIの発展の両立が図られています。

さらに、実在する有名人や公人の画像を生成することを防止するポリシーも厳格に適用されています。これにより、特定の個人をターゲットにしたフェイク画像の作成や、肖像権の侵害を技術的な制限によって未然に防ぐ仕組みが整えられています。ユーザーが意図的にルールを回避しようとする不適切なプロンプトを入力した場合でも、システムがポリシー違反と判断すれば生成プロセスは即座にブロックされます。

日本の著作権法におけるリスクと商用利用の注意点

AI生成物をビジネスで活用する際、最も注意すべきなのが著作権侵害のリスクです。日本の著作権法は、AIの学習データとしての利用(情報解析のための複製など)に関しては、世界的に見ても比較的寛容な枠組みを持っています。しかし、AIによって生成された画像を実際のビジネスで利用する 利用段階 においては、全く別の法的判断が下される点に注意が必要です。

AI生成物の利用段階での著作権侵害リスクは、AIの開発企業ではなく、画像を生成・公開した ユーザー側が直接負う ことになります。たとえAIの学習データが合法的に収集されたものであっても、生成されたコンテンツが既存の著作物に類似している場合、ユーザーは深刻な民事および刑事責任に直面する可能性があります (出典: Generative AI and Japanese Copyright Law: A Legal Risk Guide for Businesses)。

したがって、画像生成機能を商用利用しようと進める企業は、「AIが生成したものだから著作権フリーで安全である」という誤った認識を改める必要があります。生成された画像が既存のイラストや写真、企業のロゴなどに類似していないか、類似画像検索ツールなどを用いて公開前に確認するプロセスが不可欠です。

安全に活用するためのプロンプト設計のポイント

企業が法的・倫理的リスクを最小限に抑えながら画像生成AIを活用するには、入力する指示文の工夫が重要になります。

安全に画像を生成するためのプロンプトを設計する基本は、特定の固有名詞に依存しないことです。既存のキャラクター名、実在の人物名、特定のアーティスト名を含めることは、意図せず著作権や肖像権を侵害するリスクを高めます。代わりに、「水彩画風」「サイバーパンク調」「明るいオフィスで働く多様な人々」といった、一般的な形容詞や抽象的なスタイル指定を組み合わせることで、オリジナル性が高く安全な画像を生成することができます。

AIツールはあくまで人間の創造性を拡張するための補助手段です。生成された結果をそのまま鵜呑みにするのではなく、企業のコンプライアンス基準や倫理ガイドラインに照らし合わせて適切にフィルタリングすることで、初めてビジネスにおける安全かつ効果的な活用が実現します。

クリエイティブ業界におけるDALL-E 3の活用事例と注意点

クリエイティブ領域における商用利用の現状

AI画像生成技術の進化により、多くの企業が業務効率化とクリエイティビティの拡張を目的にDALL-E 3を導入しています。特に広告代理店、Web制作会社、コンテンツ制作プロダクションなどのクリエイティブ業界では、アイデアの視覚化から最終成果物の素材作成まで、幅広いフェーズで活用が進んでいます。

ChatGPTによる画像生成の商用利用を検討する際、単に画像を生成するだけでなく、各業界のビジネス要件やブランドガイドラインに沿った出力が求められます。そのためには、業界特有の課題を解決するための適切なアプローチと、リスクを回避するためのポリシー理解が不可欠です。

業界別の具体的な活用事例

企業が商用利用でAI画像生成ツールを活用する事例として、主にマーケティング・広告、製品・商品デザイン、Webサイト・ブランド開発、プロトタイプ作成などが挙げられます(出典: Can You Use AI-Generated Images Commercially? | Leonardo.Ai)。それぞれの業界・領域における具体的な活用方法を整理します。

1. マーケティング・広告 デジタルマーケティングの現場では、SNSの投稿画像、ブログのヘッダー、メールマガジンのビジュアル、デジタル広告のクリエイティブなどを迅速に作成するためにDALL-E 3が活用されています。キャンペーンのターゲット層やブランドのトーン&マナーに合わせた多様なビジュアルを短時間で大量に生成できるため、A/Bテストの実施サイクルを高速化できます。

2. 製品・商品デザイン アパレルや雑貨の企画開発において、Tシャツ、ポスター、マグカップなどのプリント・オン・デマンド商品向けグラフィックデザインの作成にAIが利用されています。デザイナーはゼロからラフを描く代わりに、イメージに近い画像を生成し、それをベースに細部をブラッシュアップすることで、商品企画のリードタイムを大幅に短縮しています。

3. Webサイト・ブランド開発およびプロトタイプ作成 Webデザインの初期フェーズでは、クライアントとのイメージ共有が重要です。DALL-E 3を用いて、Webサイトのヒーローイメージのアイデア出しや、ブランドコンセプトを体現するムードボードの作成が行われています。本格的な撮影やイラスト制作に入る前に高精度のプロトタイプを提示できるため、ステークホルダー間の認識のズレを防ぐことができます。

これらの業務において期待通りの結果を得るためには、目的やターゲット、ブランドのトーンを明確に指示するプロンプトの設計スキルが現場のクリエイターに求められます。

DALL-E 3の安全機能とコンテンツポリシー

クリエイティブ業界でAIを活用する際、最も注意すべき点が著作権や肖像権の侵害リスクです。既存の作品や人物に酷似した画像を商用利用すると、深刻な法的トラブルに発展する可能性があります。

この課題に対し、OpenAIはシステムレベルで強力な安全対策を実装しています。DALL-E 3には、生存するアーティストのスタイルでの画像生成要求を拒否する機能や、有名人・公人の画像生成を防止するコンテンツポリシーが組み込まれています(出典: DALL·E 3 | OpenAI)。

たとえば、広告クリエイティブを作成する際、「特定の現代アーティストの画風で描いてほしい」といった指示を出しても、システム側でリクエストが自動的にブロックされます。また、実在の政治家や俳優を起用したようなフェイク画像の生成も厳格に制限されています。さらに、クリエイターは自身の画像を将来の画像生成モデルのトレーニングから除外(オプトアウト)する申請も可能です。

実務で安全に活用するためのプロンプト設計

システム側で安全機能が提供されているとはいえ、企業が商用利用を行う際は、利用者側でも権利侵害を防ぐための運用ルールを設ける必要があります。

安全かつ実用的なプロンプトを構築するための基本原則は、特定の個人名やアーティスト名に依存せず、表現したい「要素」を言語化することです。たとえば「〇〇(有名画家)風のイラスト」と指示するのではなく、「水彩画風の淡いタッチで、パステルカラーを基調とした温かみのあるイラスト」のように、技法、色彩、光の当たり方、構図などを具体的に指定します。

このように、表現の構成要素を分解して言語化することで、特定の著作物に依存しないオリジナルの画像を生成しやすくなります。広告やWebデザインの現場でDALL-E 3を業務に組み込む際は、こうしたプロンプトの記述ルールを社内ガイドラインとして明文化し、クリエイター間で共有することが、安全な商用利用の第一歩となります。

まとめ

ChatGPTの画像生成機能(DALL-E 3)は、ビジネスにおけるクリエイティブ制作に革新をもたらす強力なツールです。OpenAIの利用規約上、生成画像の商用利用は許可されていますが、企業がその恩恵を最大限に享受するためには、法的・倫理的リスクへの深い理解と適切な対策が不可欠です。

本記事では、以下の重要ポイントを解説しました。

- OpenAIの利用規約を定期的に確認し、変更に迅速に対応すること。

- 著作権侵害のリスクを回避するための社内ガイドラインを策定すること。

- バイアスやフェイク画像といった倫理的・社会的問題に配慮し、対策を講じること。

- 業界特有のニーズに応え、オリジナル性を高めるプロンプトの記述スキルを磨くこと。

AI技術は進化を続けており、企業は常に最新の情報をキャッチアップし、柔軟に戦略を調整していく必要があります。これらの知見を活かし、安全かつ効果的にAI画像生成をビジネスに組み込むことで、競争優位性を確立できるでしょう。

この記事を書いた人

タジケン

テクラル合同会社

一部上場企業を経て広告代理店に入社し、デジタルマーケティングの知見を深める。現在はテクラルにて、数千万規模の大型案件でプロジェクトリードを担当。KPI設計や広告運用などのマーケティング領域から、AIを活用したシステム開発の導入支援までプロダクトの成長を一気通貫でサポートしている。本ブログでは、事業フェーズに合わせた実践的なノウハウをお届けする。