LLMOpsとは?生成AIシステムを安定運用する6つのポイント|企業向け完全ガイド

コセケン

テクラル合同会社

生成AIのビジネス活用が進む中、システムを本番環境で安定的に運用し、継続的に価値を生み出すことは多くの企業にとって喫緊の課題です。単にモデルを導入するだけでなく、そのライフサイクル全体を管理する仕組みが不可欠となります。

この課題を解決するのが LLMOps です。LLMOpsを適切に導入することで、生成AIシステムの品質を維持し、コストを最適化しながら、ビジネス成果へと繋げることが可能になります。

本記事では、企業が生成AIシステムを安定運用するために押さえるべき6つの実践的なポイントを具体的に解説します。

1. ライフサイクル全体の定義とモデル選定

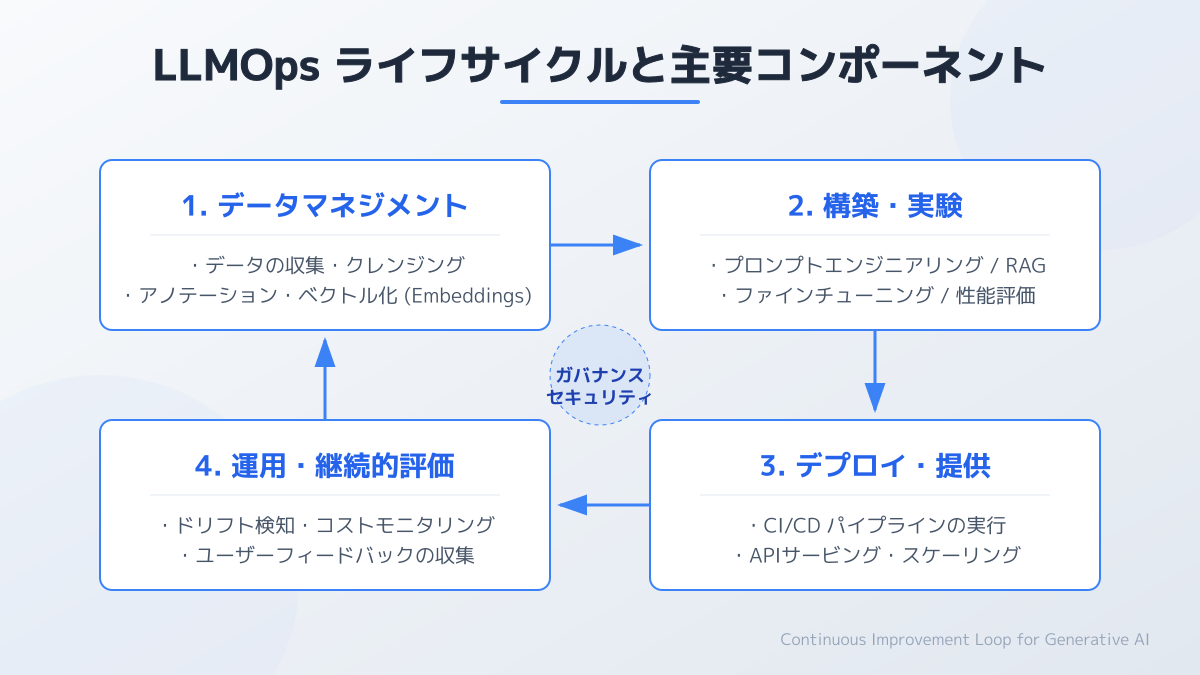

LLMOpsとは、大規模言語モデル(LLM)を本番環境で安定的かつ継続的に運用するための仕組みや手法を指します。

LLMOpsを導入する際の最初のポイントは、モデルの選定からデプロイ、そして運用監視に至る一連のライフサイクルを明確に定義することです。従来の機械学習オペレーション(MLOps)と似ていますが、LLM特有のプロンプトエンジニアリングの統合や、膨大な計算リソースの管理が求められる点が異なります。

モデル選定と運用体制の判断基準

自社システムに組み込む際、どのモデルを採用するかの判断は LLMOps構築の要 です。例えば、機密性の高い社内データを扱う金融・医療系システムでは、Llama 3やMistralなどのオープンソースモデルを自社環境(VPC内)でホスティングする運用が適しています。一方、迅速な立ち上げや高度な推論を優先するカスタマーサポートAIなら、OpenAI API(GPT-4o)やAnthropic API(Claude 3.5 Sonnet)といった商用APIの活用が有効です。コストやセキュリティ要件、求められるレスポンス速度を軸に、最適なアプローチを具体化する必要があります。

現場での運用監視における注意点

現場で運用する際の注意点として、モデルの出力精度の劣化や、不適切な回答(ハルシネーション)を防ぐ 監視体制の構築 が挙げられます。プロンプトのバージョンを正確に管理し、ユーザーからのフィードバックを継続的にシステム改善へ反映させる仕組みが不可欠です。

LLMを活用した新規サービスを立ち上げる際は、技術的な運用基盤だけでなく、ビジネス視点での戦略も求められます。新規事業開発を成功に導く7つの実践論とコンサルの賢い活用法も参考に、事業全体の設計と運用体制を並行して進めることが重要です。

要点として、LLMOpsの成否は開発チームと運用チームのシームレスな連携にかかっています。初期段階から継続的な監視と改善のサイクルを組み込むことで、生成AIシステムは初めてビジネスに貢献する安定した基盤となります。

2. プロンプトのバージョン管理と継続的な評価

LLMOpsを実践する上で欠かせない2つ目のポイントは、プロンプトのバージョン管理と継続的な評価です。大規模言語モデル(LLM)は、入力されるプロンプトのわずかな違いで出力精度が大きく変動します。そのため、どのバージョンのプロンプトが最適かを管理し、客観的に評価する仕組みが不可欠です。

プロンプト管理の基本事項と判断ポイント

LLMを組み込んだシステムでは、従来のソフトウェア開発とは異なり、コードだけでなく自然言語による指示(プロンプト)のライフサイクル管理が求められます。LLMOpsの判断ポイントとして重要なのは、プロンプトの変更履歴を追跡できるか、そして変更前後の出力結果を定量的に比較・評価できるかという点です。

たとえば、新しいプロンプトを採用する際、一部のテストデータでは良好な結果が出ても、特定の条件下で予期せぬ回答(ハルシネーション)を生成するリスクがあります。そのため、LangSmithやPrompt flowといったプロンプト管理・評価に特化したツールを活用し、自動化された評価パイプラインを構築することが推奨されます。これにより、変更前後のプロンプトの応答精度やレイテンシを定量的に比較し、事前に定義した指標(例:正答率90%以上)に基づいて本番環境へデプロイするかどうかをデータドリブンに判断できるようになります。

現場運用の注意点と要点の整理

現場でLLMOpsを運用する際の最大の注意点は、基盤モデル自体のアップデートによる影響です。API経由で利用しているLLMのバージョンが更新されると、これまで正しく機能していたプロンプトが突然意図しない挙動を示すことがあります。このリスクを軽減するためには、出力の品質低下を検知するモニタリング体制を整えることが重要です。

これらの要点を整理すると、最初から完璧な評価システムを構築するのではなく、まずは最小限の機能で仮説検証を繰り返すアプローチが効果的です。このプロセスは、新規事業の立ち上げ手法と共通する部分が多くあります。具体的な検証の進め方については、MVP開発とは?新規事業を成功へ導くアジャイルな進め方と検証のポイントも参考にしてください。小さく始めて継続的に改善を回すことが、生成AIシステムの安定稼働につながります。

3. モデル出力の継続的な監視とKPI設定

生成AIを本番環境で安定稼働させる上で欠かせない要素が、モデル出力の継続的な評価と監視です。このセクションでは、出力品質の担保という観点から要点を整理します。

評価と監視に関する基本事項

LLM(大規模言語モデル)は、従来のソフトウェアのように「同じ入力に対して常に同じ結果」を返すとは限りません。そのため、LLMOpsの枠組みにおいて、モデルの回答精度や安全性を定期的に評価する仕組みが不可欠です。

具体的には、ハルシネーション(事実に基づかないもっともらしい嘘)の発生率や、機密情報の漏洩リスクを監視する必要があります。最近では、Ragas(RAG Assessment)やTruLensなどの評価フレームワークを用いて、回答の「文脈の関連性(Context Relevance)」や「事実との整合性(Faithfulness)」を自動でスコアリングする事例が増えています。これに加え、ブランドのトーン&マナーに反する表現が含まれていないかを、人間の目(ヒューマンインザループ)で最終チェックするプロセスを組み合わせるのが理想的です。

現場での判断ポイントの具体化

運用フェーズにおいて、モデルの再チューニングやプロンプトの修正を実行するタイミングの判断は非常に重要です。現場では、APIの応答速度(レイテンシ)やトークン消費に伴うインフラコストに加え、ユーザーからの直接的なフィードバックを複合的に分析します。

たとえば、「特定業務での正答率が80%を下回った場合」や「1リクエストあたりのコストが想定を20%超過した場合」など、事前に明確な KPI を設定しておくことが重要です。これにより、属人的な判断を排除し、データに基づいた迅速な対応が可能になります。

運用時の注意点と要点の整理

現場でLLMOpsを運用する際の最大の注意点は、時間の経過に伴うモデル精度の劣化(ドリフト)を見落とさないことです。一度システムをデプロイして終わりではなく、最新の社内ドキュメントや市場動向に合わせて、RAG(検索拡張生成)の参照データベースを継続的に更新する必要があります。

要点を整理すると、システムを安全かつ効果的に運用するためには、定量的なメトリクス(処理速度、コスト)と定性的なメトリクス(回答の正確性、ユーザー満足度)の両面からモニタリングを行うことが求められます。この評価ループを可能な限り自動化し、異常を即座に検知できる監視ダッシュボードを整備することが、プロダクトを成長させるための鍵となります。

4. 品質維持とコストのバランス最適化

LLM(大規模言語モデル)を本番環境に組み込む際、単にAPIを接続して開発完了とはなりません。ここでは、運用フェーズにおける品質維持とコスト管理という観点から基本事項を整理します。LLMは時間の経過とともにユーザーの入力傾向が変化し、出力の精度や関連性が低下するリスクを抱えています。そのため、継続的な評価と監視の仕組みを構築することが、実践的なLLMOpsの要となります。

運用における判断ポイントの具体化

システムにLLMを組み込む際の大きな判断ポイントは、「モデルの出力精度」「応答速度(レイテンシ)」「API利用コスト」の3つのバランスをどのように取るかです。

たとえば、社内業務効率化を目的としたAIエージェントであれば、多少のレイテンシは許容してでも、推論能力の高い巨大なモデルを採用する判断が適しています。一方、BtoC向けのモバイルアプリでリアルタイム性が強く求められる場合は、軽量で高速なモデルを採用し、プロンプトエンジニアリングやRAG(検索拡張生成)で精度を補完するアプローチが有効です。事業フェーズやプロダクトの要件に合わせて、これらの指標を定量的に計測し、最適化を図る必要があります。

現場で運用する際の注意点

実際の開発現場でLLMを運用する際、最も注意すべきは「ハルシネーション(もっともらしい嘘)」と「不適切な出力」の制御です。ユーザーの入力は開発者の想定を超えることが多いため、入力と出力の両方にガードレール(自動フィルタリング機構)を設けることが不可欠です。

また、基盤モデルのAPIがバージョンアップされることで、突然出力フォーマットが変化し、後続のシステムがエラーを起こすケースも少なくありません。そのため、プロンプトのバージョン管理と、期待する出力が得られるかを確認する自動テストをCI/CDパイプラインに組み込むことが強く推奨されます。

LLMOpsのベストプラクティス一覧

現場での運用を安定させるための具体的なベストプラクティスを以下の表に整理します。

| 運用項目 | 具体的な対策事例 | 期待される効果 |

|---|---|---|

| 出力品質の監視 | Ragas等のツールを用いた文脈関連性の自動スコアリング、定期的な目視テスト | ハルシネーションの低減と精度の維持 |

| コスト管理 | Redis等を活用したセマンティックキャッシュ(類似質問への回答再利用)の導入 | API利用料の最適化と応答速度の改善 |

| セキュリティ | NeMo Guardrails等を利用した不適切発言のブロック、PII(個人情報)のマスキング処理 | 情報漏洩の防止とブランドリスクの回避 |

| バージョン管理 | LangSmith等でのプロンプトバージョンとLLMモデルバージョン(例: gpt-4-0613)のセット管理 | 再現性の確保と迅速なロールバック |

継続的な監視と改善のサイクル

このセクションにおける最大の要点は、システムをリリースして終わりではなく、継続的な監視と改善のサイクルを回すことです。品質、コスト、セキュリティの各指標をダッシュボードで常に可視化し、異常を早期に検知できる開発・運用体制を整えることが、生成AIシステムの安定稼働とビジネスの成長に直結します。

5. ビジネス要件に基づくモニタリング体制の構築

LLMOpsにおける5つ目の重要なポイントは、本番環境における継続的なモデル評価とモニタリング体制の構築です。大規模言語モデル(LLM)は入力に対して非決定的な出力を行うため、従来のソフトウェア開発以上に、リリース後の継続的な監視が不可欠となります。

監視すべき指標の判断ポイント

システムを安定稼働させるための判断ポイントは、監視対象をビジネス要件に合わせて具体化することです。システムパフォーマンス(応答速度やトークン消費量によるコスト)だけでなく、回答の品質(正確性やトーン&マナー)、そしてハルシネーション(事実に基づかない出力)の発生頻度を複合的に評価する必要があります。自社のプロダクトにおいて、どの指標の悪化が最も致命的なリスクになるかを事前に定義し、優先順位をつけて監視ダッシュボードを設計することが重要です。

現場で運用する際の注意点

現場でLLMOpsを運用する際、最も注意すべきはアラートの最適化とチーム間の連携です。すべての異常を検知しようとするとアラートが過剰になり、運用担当者の疲弊を招きます。そのため、ユーザー体験に直結する重大なエラーに絞って即時通知を行い、軽微な品質低下は定期的なレポートで確認するといったメリハリが求められます。

また、運用チームが検知した課題を、プロンプトエンジニアや開発チームへ迅速にフィードバックする仕組みづくりも欠かせません。

運用体制の要点整理

ここまでの要点を整理すると、以下の3点に集約されます。

- ビジネス要件に基づく指標設計: コスト、パフォーマンス、回答品質のバランスを定義する

- アラートの最適化: 運用現場が疲弊しないよう、通知の閾値を適切に設定する

- フィードバックループの構築: 監視結果を速やかに開発へ還元し、モデルやプロンプトの改善に繋げる

これらの要点を押さえることで、生成AIシステムは時間の経過とともに劣化するのではなく、継続的に成長するプロダクトへと進化します。

6. ROIを最大化するリソース最適化とコスト管理

LLMOpsにおける6つ目の重要ポイントは、継続的なコスト管理とリソース最適化です。生成AIシステムは、従来のソフトウェア開発と比較してAPI利用料や推論時のインフラ費用が膨らみやすい特性があります。そのため、LLMOpsの枠組みの中で、性能とコストのバランスを常に監視し、最適化するプロセスが不可欠です。

コスト管理における具体的な判断ポイントは、タスクの難易度に応じたモデルの使い分け(LLMルーティング)です。例えば、ユーザーの意図を解釈する最初の入り口や複雑な推論にはGPT-4oなどの高性能モデルを利用し、単純なデータ抽出や定型的なテキスト要約にはGPT-4o-miniやLlama 3 8Bなどの軽量・安価なモデルへ自動で振り分けるアーキテクチャが効果的です。また、過去の類似質問に対してLLMを通さずキャッシュから即座に回答を返すセマンティックキャッシュ(Semantic Cache)を導入することで、APIコストの劇的な削減とレスポンスタイムの向上が見込めます。

現場で運用する際の注意点として、利用量の異常な急増(スパイク)への対策が挙げられます。本番環境では、ユーザーの予期せぬ操作やシステムエラーによってAPIコールが急増するリスクがあります。これを防ぐため、ユーザー単位での利用上限(レートリミット)の設定や、リアルタイムでの コストモニタリングとアラート通知 を必ず実装してください。

このポイントの要点は、単にインフラ費用を削ることではなく、事業の投資利益率(ROI)に見合った運用体制を構築することです。コストの可視化と制御の仕組みを開発初期から組み込むことで、プロダクトの成長フェーズにおいても安定したシステム運用が実現します。

まとめ

本記事では、企業が生成AIシステムを安定的に運用し、ビジネス価値を最大化するために不可欠な LLMOps の6つの実践的なポイントを解説しました。

- ライフサイクル管理: モデル選定からデプロイ、運用監視まで一貫したプロセスを定義する。

- プロンプト管理と評価: プロンプトのバージョン管理と継続的な出力評価で精度を維持する。

- 継続的な監視と改善: モデル出力の品質、安全性、倫理性を常にモニタリングし、改善サイクルを回す。

- 品質維持とコスト管理: 運用フェーズでの品質維持とコスト最適化のバランスを取る。

- モニタリング体制の構築: ビジネス要件に合わせた監視指標とフィードバックループを確立する。

- リソース最適化: コストの可視化と制御を初期から組み込み、ROIに見合った運用を実現する。

これらのポイントを押さえることで、生成AIシステムは単なる技術導入で終わらず、企業の競争力を高める強力な資産へと進化します。継続的な改善と運用体制の最適化を通じて、生成AIの可能性を最大限に引き出しましょう。

LLMOpsを運用に落とし込むときは、本文で整理した判断基準を順に確認してください。

この記事を書いた人

コセケン

テクラル合同会社

スタートアップでのCTO経験を経て、現在はテクラル合同会社にてシステム開発全般を牽引しています。アプリおよびWebの開発から、バックエンド、インフラ構築に至るまで幅広い技術領域に対応可能です。スピード感を持った品質の高いシステム開発を得意としており、新規プロダクトの立ち上げを一気通貫で支援します。本ブログでは実践的な開発ノウハウを発信していきます。