LLM as a Judgeとは?AI評価を自動化する仕組みと導入メリット

コセケン

テクラル合同会社

LLM as a Judgeとは、大規模言語モデル(LLM)自身を評価者として用い、他のAIモデルの出力品質を自動判定する手法です。従来の手作業による評価の限界を克服し、一貫性のある基準で効率的かつ迅速な検証を実現します。本記事では、LLM as a Judgeとは何かという基本概念から、具体的な仕組み、導入によるビジネス上のメリット、さらには運用における課題と対策、評価精度を高める実践的な戦略、そして将来性までを網羅的に解説します。生成AIを活用したプロダクト開発を加速させたい方へ、具体的な知見を提供します。

LLM as a Judgeとは?基本の概念

LLM as a Judgeとは、大規模言語モデル(LLM)自身を評価者として用い、他のAIモデルが出力したテキストの品質を自動判定する手法です。従来の生成AI評価は、人間が目視で回答の正確性や自然さを確認する必要があり、膨大な時間とコストがかかることが課題でした。このプロセスを高性能なLLMに代替させることで、迅速かつスケーラブルな評価体制を構築できます。

評価を機能させるための条件

LLMを評価者として機能させるには、主に「回答の正確性」「プロンプトへの追従性」「表現の適切さ」の3つを測る必要があります。事前に明確な ルーブリック(評価基準) を設定し、それに基づいてスコアリングやフィードバックを生成させることが重要です。

一方で、評価を行うLLM自身がハルシネーション(もっともらしい嘘)を起こすリスクや、特定の表現に対するバイアスを持つ可能性もあります。そのため、本番環境へ導入する前には、人間による評価結果とLLMの評価結果の相関性を検証する キャリブレーション(調整) 工程が欠かせません。

AIを活用したプロダクト開発や新規事業の立ち上げにおいて、こうした評価プロセスの自動化は開発スピードを劇的に向上させます。AI導入を含む事業成長の全体的な進め方については、新規事業開発を成功に導く7つの実践論とコンサルの賢い活用法 も併せて参考にしてください。

LLM as a Judgeの仕組みと評価プロセス

LLM as a Judgeの仕組みは、あるLLMが生成した回答を、別の強力なLLM(ジャッジLLM)が自動的に評価するというものです。この評価プロセスを導入することで、人間による目視確認のコストを大幅に削減し、一貫性のある評価基準を適用できます。

評価プロセスと判断ポイント

一般的な評価プロセスは、以下の3ステップで進行します。

- 評価基準の定義: 正確性、関連性、トーン&マナーなど、評価したい項目をプロンプトとして明確に設定します。

- 回答の入力: 評価対象のLLMが出力したテキストと、正解データ(または参照情報)をジャッジLLMに渡します。

- スコアリングとフィードバック: ジャッジLLMが基準に従って点数をつけ、改善点を出力します。

評価プロンプトの具体例(サンプル)

LLMを評価者として機能させるためには、採点基準を明確に言語化したプロンプトが必要です。以下は「回答の正確性」を5段階で評価させるためのプロンプトの具体例です。

あなたは厳格なAI評価者です。以下の[参照情報]をもとに、[AIの回答]の正確性を1〜5点の5段階で評価し、その理由を簡潔に出力してください。

【評価基準】

5点: 参照情報と完全に一致しており、情報に不足や誤りがない。

4点: ほぼ正確だが、些細なニュアンスの欠落がある。

3点: 基本的な内容は合っているが、一部に不正確な情報が含まれる。

2点: 誤った情報が多く含まれており、実用に耐えない。

1点: 参照情報と全く関係がない、または完全に誤っている。

[参照情報]

(ここに参照データや正解となるテキストを入力)

[AIの回答]

(ここに評価対象のAIが出力したテキストを入力)

【出力フォーマット】

スコア: [1〜5の数字]

理由: [評価の理由を100文字以内で記述]

このように具体的なルーブリック(評価基準)と出力フォーマットを指定することで、評価のブレを最小限に抑えることができます。

ハルシネーションのリスクと対策

自動評価プロセスを構築する際は、ジャッジLLM自身のバイアスやハルシネーションへの対策が必要です。評価のブレを防ぐためには、定期的に人間が評価結果をサンプリングして検証する「ヒューマン・イン・ザ・ループ」の仕組みが不可欠です。

また、生成AIを活用したプロダクトを素早く立ち上げる際は、評価基盤の構築と並行して機能検証を進めることが重要です。初期フェーズでの具体的な進め方については、MVP開発とは?新規事業を成功へ導くアジャイルな進め方と検証のポイントも参考にしてください。

LLM as a Judge導入のメリットとビジネス価値

生成AIをプロダクトに組み込む際、出力品質の継続的な担保は大きな課題です。ここでLLM as a Judgeを導入することで、評価自動化による大幅なコスト削減と品質改善というメリットを得られます。

評価自動化がもたらすビジネス貢献

従来、AIの出力結果は人間が目視で評価していましたが、この手法はスケールせず、多大な人件費と時間を要します。LLM as a Judgeを導入し、評価プロセスを自動化することで、開発サイクルを劇的に高速化できます。結果として、新機能のリリース期間短縮や、ユーザー体験の向上といった直接的なビジネス貢献に繋がります。

客観的な評価基準による品質向上

LLM as a Judgeのメリットを最大化するには、評価基準の明確化が不可欠です。「回答が正確か」といった曖昧な基準ではなく、「指定したフォーマットに従っているか」「特定のNGワードを含んでいないか」など、システムが客観的に判断できるポイントを具体化する必要があります。これにより、属人性を排除した安定した品質の担保が可能になります。

LLM as a Judgeの課題とバイアスへの対策

LLM as a Judgeは生成AIの出力を効率的に評価できる強力な手法ですが、実運用においてはいくつかの課題やデメリットが存在します。特に注意すべきなのが、AIモデル自身が持つバイアス(偏り)です。

LLMは学習データに基づいて回答を生成するため、特定の出力形式や長文を無意識に高く評価してしまう傾向があります。また、ハルシネーションを引き起こし、誤った評価を下すリスクもゼロではありません。これらのLLM as a Judgeの課題を放置すると、プロダクトの品質低下に直結します。

バイアスを軽減するための対策

評価の精度と客観性を保つためには、以下の対策が有効です。

- 評価基準の明確化: プロンプト内で「何を基準に採点するか」を具体的かつ定量的に定義します。

- 複数モデルの併用: 特定のモデルの癖に依存しないよう、異なるLLMを用いて評価結果をクロスチェックします。

- プロンプトの順序入れ替え: 選択肢の提示順によって評価が変わる「位置バイアス」を防ぐため、入力順序を入れ替えてテストを行います。

人間による最終レビューの重要性

自動化による効率化を目指す場合でも、完全な無人化に固執しないことが重要です。AIによる一次評価をベースにしつつも、重要な判断や例外的なケースにおいては、人間による最終レビュー(Human-in-the-Loop)を組み込む体制を構築することが、安全かつ効果的な運用の鍵となります。

評価精度を高める戦略とLLM選定のポイント

LLM as a Judgeの導入効果を最大化するには、評価の質を担保する仕組みと、評価者となるモデルの適切な選択が不可欠です。ここでは、実践的な精度向上策と選定基準を解説します。

評価精度を高めるためのアプローチ

LLM as a Judgeの精度を高める鍵は、評価基準(ルーブリック)の明確化です。「正確性」などの抽象的な指示ではなく、具体的な採点基準や減点項目をプロンプトに組み込み、判断のブレを防ぎます。

また、評価システムが正しく機能しているかを検証する メタ評価 も欠かせません。人間の評価と LLM の評価の相関を定期的に分析し、ズレがあればプロンプトをチューニングして要点を整理し直します。

代表的な評価フレームワークの活用

ゼロから評価パイプラインを構築するのではなく、LLM as a Judgeの実装を支援する既存の評価フレームワークを活用するのも有効な戦略です。代表的なツールには以下のようなものがあります。

- Ragas (Retrieval Augmented Generation Assessment): 主にRAG(検索拡張生成)の評価に特化したフレームワークで、回答の忠実性や検索精度のスコアリングに優れています。

- TruLens: LLMアプリケーションの入力と出力をモニタリングし、「ハルシネーションの度合い」や「関連性」を数値化してフィードバックする機能を提供します。

- LangSmith: LangChainの開発元が提供するプラットフォームで、プロンプトの実行ログを可視化し、テストデータセットを用いた継続的な評価を容易にします。

これらのフレームワークを導入することで、評価ロジックの実装コストを下げ、標準化された指標でモデルのパフォーマンスを計測できます。

評価者となるモデルの選定基準

Judge 役の LLM には、高い推論能力と一貫性が求められます。以下の比較軸を参考に、評価用モデルの選定を行ってください。

| 比較軸 | 評価のポイント | 考慮すべき事項 |

|---|---|---|

| 推論能力 | 複雑な評価基準を理解し判定できるか | GPT-4 などの高性能モデルの活用 |

| コスト | 大量データを評価する際の API 利用料 | 予算に応じた軽量モデルとの使い分け |

| 処理速度 | リアルタイム評価かバッチ処理か | ユースケースに応じたレイテンシの許容範囲 |

| コンテキスト長 | 長文データや複雑なルーブリックを処理できるか | 入力トークン数に応じたモデル選択 |

現場でLLM as a Judgeを運用する際は、複数モデルでのクロスチェックも有効です。自社の課題に合わせ、評価精度とコストのバランスを最適化する戦略を描くことが成功に繋がります。

LLM as a Judgeの活用事例と将来性

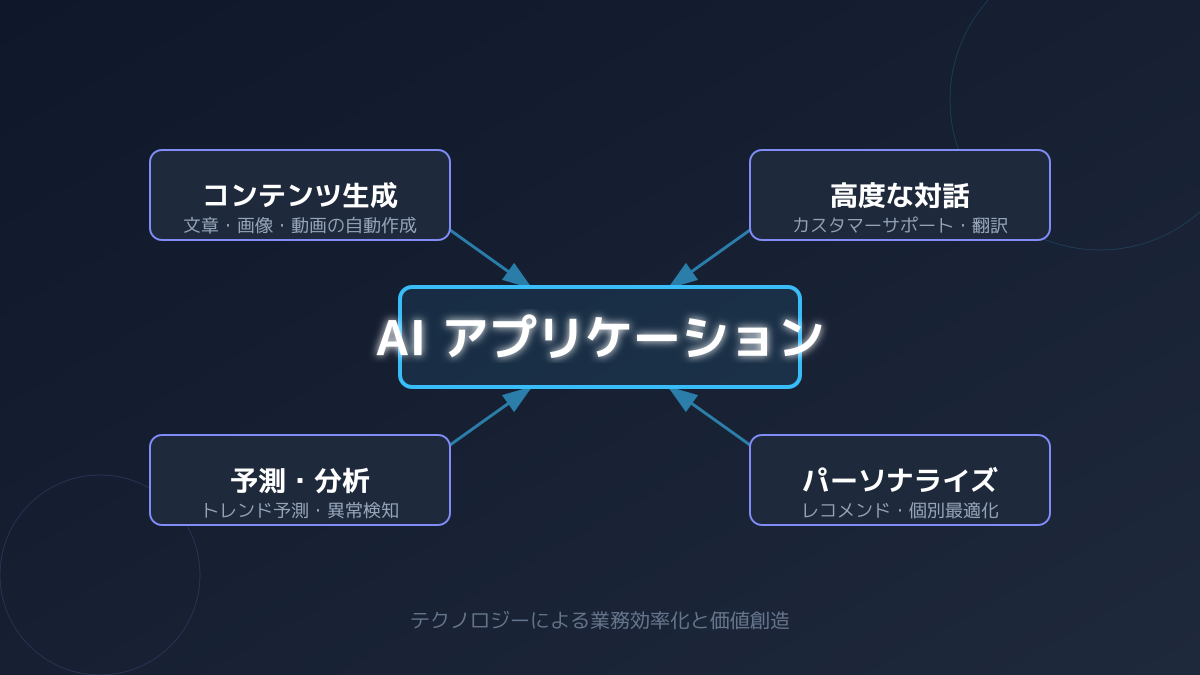

生成AIを組み込んだプロダクトが急増する中、 LLM as a Judge は多様なビジネスシーンで実用化が進んでいます。代表的な活用事例としては、カスタマーサポート向けチャットボットの回答品質モニタリングや、社内文書を基にしたRAG(検索拡張生成)システムの精度検証が挙げられます。これらの事例では、人間が目視で確認していた膨大なログをAIが自動評価することで、大幅な工数削減と継続的な改善サイクルを実現しています。

効果的な運用のための鍵となるのは、評価基準となるプロンプトの設計です。評価者としてのLLMに対して「正確性」「トーン&マナー」「有害性の有無」といった具体的な採点基準を明示しなければ、評価結果にブレが生じます。また、評価用LLM自体が誤った判定を下すリスクや、API利用料の増加にも配慮する必要があります。そのため、全件評価ではなくランダムサンプリングを併用したり、定期的に人間の専門家が評価結果を監査する体制構築が不可欠です。

将来的には、テキストだけでなく画像や音声、動画を同時に処理できる マルチモーダルLLM の進化により、LLM as a Judgeの適用範囲はさらに拡大します。例えば、ユーザーがアップロードした画像に対するAIの解説が適切かどうかを自動判定するなど、より複雑で高度な品質保証が可能になります。生成AIの進化と歩調を合わせ、自動評価の仕組みも高度化していくことは間違いありません。

LLM as a Judgeを運用する7つのポイント

LLM as a Judgeを効果的に運用し、生成AIの出力に対して正確な判断を下すためには、以下の7つの要点を押さえることが不可欠です。

- 評価基準の明確化: 何をもって「正しい」とするか、評価指標(正確性、関連性、安全性など)を具体的に定義します。

- プロンプトの最適化: 評価を担うモデルに対して、曖昧さのない明確な指示を与え、一貫した判断を引き出します。

- 適切なモデルの選定: 評価タスクの複雑さに応じて、高い推論能力を持つ大規模言語モデルを的確に割り当てます。

- バイアスの定期的な監視: モデル自身が持つ偏見や、特定の回答形式を好む傾向(位置バイアスなど)がないか継続的にチェックします。

- コストと速度の最適化: 高性能なモデルはAPI利用料が高く処理に時間がかかるため、実運用に耐えうるバランスを設計します。

- 人間の専門家による検証: すべてを自動化するのではなく、定期的に人間が介入し、評価の妥当性を確認します。

- フィードバックループの構築: 評価結果をシステムのプロンプト改善やファインチューニングに還元し、継続的に精度を向上させます。

これらのポイントを具体化し、開発プロセスに組み込むことで、LLM as a Judgeの真の価値を引き出すことが可能です。運用時は、自動化のメリットを享受しつつも、モデルの限界を理解した継続的なリスク管理が求められます。

よくある質問

ここでは、LLM as a Judgeに関する質問のなかでも、特に開発担当者や事業責任者から多く寄せられる内容を整理します。

LLM as a Judgeの導入費用はどのくらいですか?

導入費用は、利用するLLMのAPI料金やシステム規模によって大きく変動します。既存の評価ツールをSaaSとして利用する場合、月額数万円程度からスモールスタートが可能です。一方、自社の業務要件に合わせた独自の評価パイプラインを構築する場合は、初期開発費用が発生します。まずは小規模な検証から始め、費用対効果を確認する手順が一般的です。

評価ツールを選定する際の基準は何ですか?

実業務に適用する上で最も重要な基準は、 人間の専門家による評価との一致率 です。モデルが自社の意図した基準通りに採点できているかを事前に検証する必要があります。また、回答の正確性だけでなく、評価プロセスにかかる処理時間やAPIの安定性も、ツール選定の重要な要素となります。

運用開始後に気をつけるべきことはありますか?

最大の注意点は、AIによる評価を完全に鵜呑みにしないことです。LLM特有のハルシネーションや、特定の出力に対するバイアスが含まれるリスクがあります。そのため、 定期的に人間が評価結果をサンプリングして確認 し、評価用プロンプトや判断基準を継続的に改善する運用体制を整えることが不可欠です。

まとめ

本記事では、生成AIの出力評価を自動化する「LLM as a Judge」について、その基本概念から仕組み、導入メリット、課題と対策、精度向上戦略、活用事例までを解説しました。

重要なポイントは以下の3点です。

- 評価の自動化と効率化: 人間による手作業評価の限界を克服し、開発スピードと品質を向上させます。

- プロンプトとモデル選定: 評価基準の明確化、適切なLLMの選択、バイアス対策が精度を左右します。

- 継続的な改善とHuman-in-the-Loop: 評価結果のフィードバックと人間による定期チェックで、長期的な精度維持に繋がります。

LLM as a Judgeは、生成AIプロダクトの品質保証と開発効率を両立させる強力なツールです。これらの知見を活かし、自社のAIプロダクトの価値を最大化してください。

この記事を書いた人

コセケン

テクラル合同会社

スタートアップでのCTO経験を経て、現在はテクラル合同会社にてシステム開発全般を牽引しています。アプリおよびWebの開発から、バックエンド、インフラ構築に至るまで幅広い技術領域に対応可能です。スピード感を持った品質の高いシステム開発を得意としており、新規プロダクトの立ち上げを一気通貫で支援します。本ブログでは実践的な開発ノウハウを発信していきます。